大模型遇见社会科学:从“人的社会”到“AI的社会” 的研究

论文标题:AI for Social Science and Social Science of AI: A Survey

论文链接:

🔗 Information Processing & Management 期刊论文链接

https://www.sciencedirect.com/science/article/abs/pii/S0306457324000256

🔗 预印版论文链接

你是否曾经思考过,一个AI与人类共同工作、共同生活的社会会是什么样的?科幻作品如《黑客帝国》中的虚拟世界、《机器人总动员》中的友善机器人WALL-E,甚至《银翼杀手》中的仿生人都为我们提供了想象的蓝本。在这些作品中,AI不再是简单的工具,而是拥有着独特行为特征的生命体,这样的幻想或许正在变为现实。

大模型技术的兴起,不仅显著提升了AI的类人能力,重新定义了AGI的可能性,也打开了AI与人类合作的崭新篇章。越来越多的学者开始将目光投向AI与社会科学的结合,探索社会模拟[1, 2]、AI治理等领域的可能性。

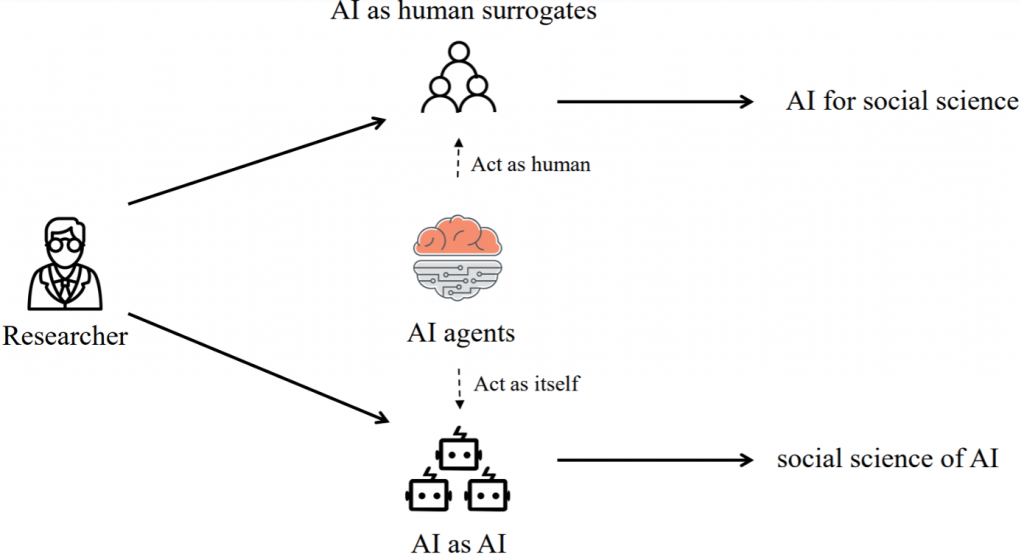

然而,当前AI与社会科学的结合通常混淆了两个截然不同的方向。一方面,由于AI的出色能力,它成为社会科学研究各个阶段的高效工具;另一方面,随着AI类人能力的增加和模仿人类社会的AI社区的出现,AI代理本身也能够被视作社会实体,以了解其独特的行为特征和对社会的影响。虽然这两个方向共享相同的技术手段,但研究目标、意义和应用范围却完全不同。例如,尽管两者都涉及社会模拟,但前者要求AI代理尽可能与人类行为对齐,以便快速、低成本、低风险地研究人类社会的运行规律;而后者则专注于探索AI自身的行为规律,尤其关注机器行为的与众不同之处,以理解机器行为的普遍现象。由于缺乏对这两个方向的全面调查,我们难以确定每项工作的研究意义和应用范围,这妨碍了我们理解和利用这两个方向之间的差异和联系。

因此,中国科学院软件研究所中文信息处理实验室团队对AI技术和社会科学的结合做了一个全面和系统性的综述。具体来说,本文主要从两个视角来探讨AI与社会科学之间的关系:1)AI for social science,即AI利用其类人智能助力传统社会科学研究;2)Social science of AI,即AI成为社会科学的研究对象,被视作社会实体来研究其行为规律。除此之外,本文还对相关资源和工具进行了搜集和比较,为这一领域的研究提供了有益的参考。该综述发表于中科院一区Top期刊 Information Processing & Management。

AI for Social Science

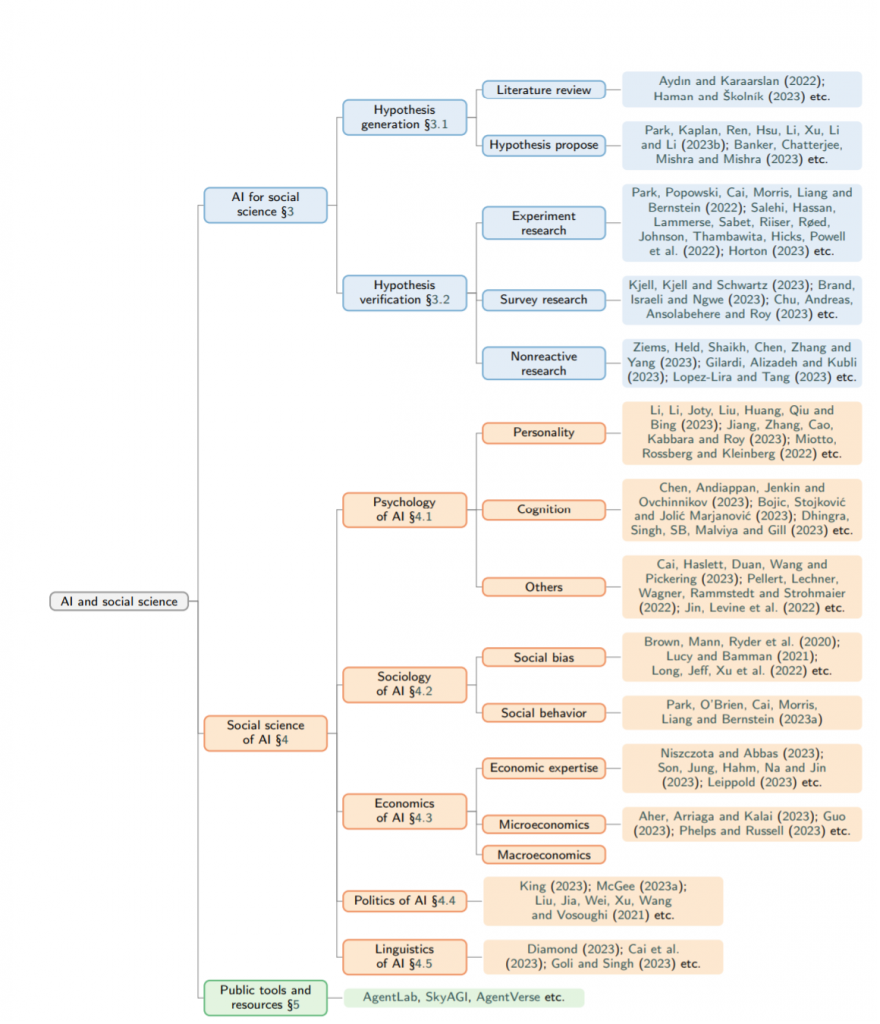

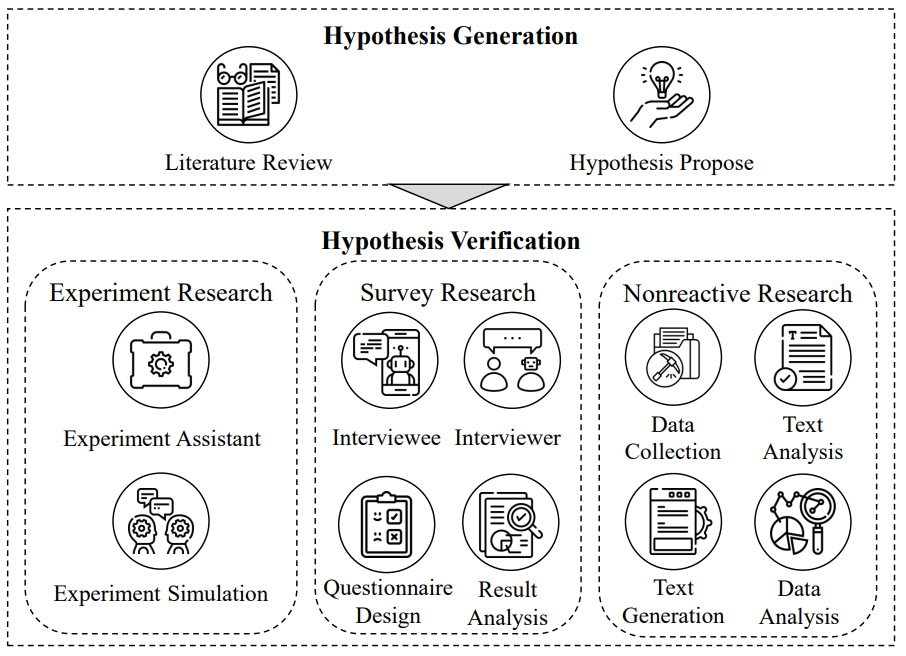

对于AI for social science方向,本文重点讨论了大语言模型作为一种高效工具整合到现有的社会科学研究方法中的潜力。如图所示,以社会科学领域的经典研究范式[3]为基础,本文系统地探讨了大语言模型在假设生成和假设验证阶段能够发挥的作用。具体来说,在假设生成阶段,主要关注大语言模型如何帮助人类进行文献综述和假设提出。在假设验证阶段,分别考察了大语言模型在实验研究、调查研究和非反应性研究等不同研究方法中的作用。

本章节旨在为社会科学研究人员在研究过程中如何应用大语言模型以提高效率提供一个全面且清晰的视角,同时揭示大语言模型尚未开发的潜力,提出潜在的风险和伦理问题,并探讨未来可能的发展方向。

以实验研究为例,大语言模型可以扮演双重角色——既可作为实验助手[4],又可作为人类行为的可信代理[1, 2],成为实验对象。尤其是后者,在人工智能和社会科学领域引起了越来越多的关注,因为大型语言模型越来越有能力模拟类似人类的反应和行为。使用大型语言模型模拟实验的优势在于提高效率,降低成本,增强可扩展性,以及回避与人类受试者相关的伦理问题,从而为在人类身上被视为不道德的实验打开了大门,比如经典的斯坦福监狱实验[5]。劣势在于透明度低,重现性差,以及“仿真度”的不确定性[2]。因此,作者鼓励研究人员进一步开发评估大型语言模型模拟质量的方法,并且结合认知科学的见解来指导人工智能代理框架的发展,以增强其行为的相似性和合理性。

Social Science of AI

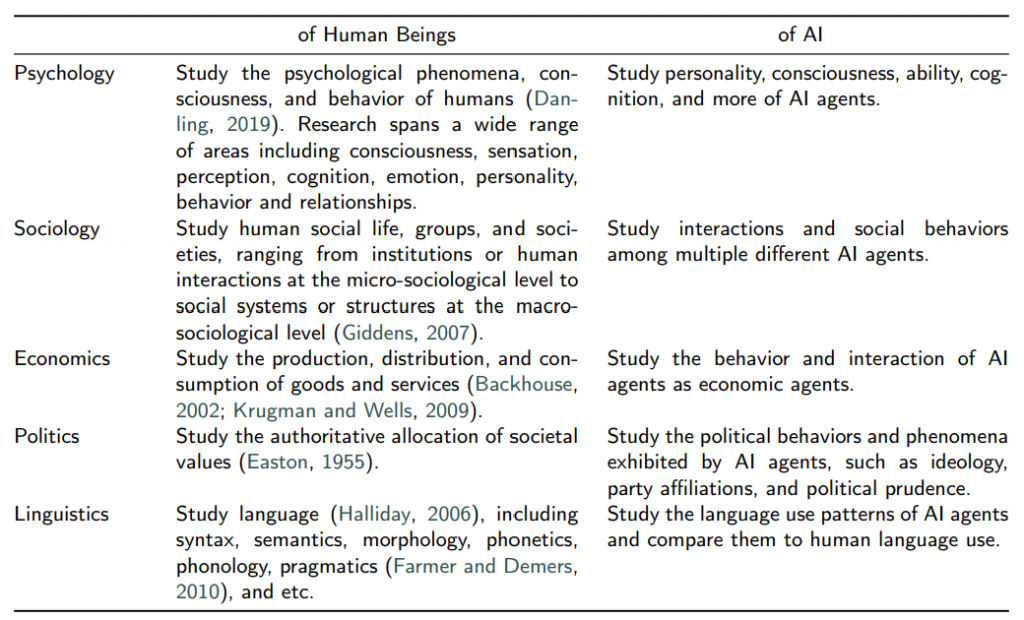

对于social science of AI方向,本文主要关注使用大型语言模型作为研究对象的社会科学研究,特别强调其与传统人类行为的区别。如图所示,本文遵循社会科学领域内的学科分类,从不同学科视角研究大语言模型作为社会实体的行为规律。

人工智能协作的行为模式、结果、影响以及驱动其协作行为变化的因素尚不清楚。与social science of human类似,social science of AI的最终目标是明确人工智能智能体作为社会实体的行为特征,以及如何建模和理解这些行为特征。这类研究对于未来人工智能集体的自主决策和控制具有重要意义。

以心理学为例,目前研究主要集中于对大语言模型的个性、认知能力等角度的探究。从个性的角度来看,大语言模型虽然整体表现出个性倾向[6-8],但不像人类一样拥有一致和稳定的个性倾向,更倾向于是多个视角的叠加[9]。从认知能力领域来看,在归纳、类比、因果推理、心理理论等方面,以GPT-3.5和GPT-4为代表的最先进的大型语言模型可以展示出与人类相当甚至超越人类的认知能力,但采取的认知模式与人类并不一致[10]。

模拟工具

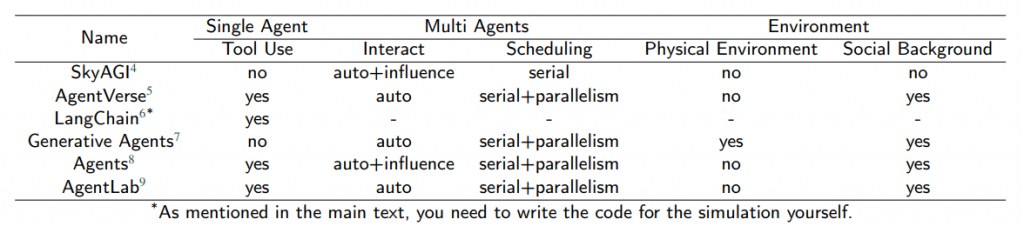

为了便于在社会科学研究中使用大型语言模型,已经存在一些公开可用的工具和资源作为辅助工具。考虑到其他应用主要依赖于直接使用或基于简单脚本的调用,本文重点介绍了基于大型语言模型的仿真工具和平台。在此框架下,对仿真需求进行了系统分析,并对各平台的功能进行了比较。

总结与讨论

本文综述了大语言模型与社会科学交叉领域的最新进展。我们提出一个二分法来概述这一领域的进展,包括“AI for social science”和“social science of AI ”。

我们注意到,大型语言模型可以集成到社会科学研究的各个阶段,作为辅助工具、灵感来源、注释工具、内容分析工具等,从而有效提升研究效率。虽然大型语言模型作为工具具有速度、成本效益、无道德风险实验和低门槛等优势,但必须仔细验证其生成文本的可靠性和真实性。替代人类进行实验和调查的可行性仍然是一个争议性问题。因此,研究人员在使用这些模型时需要考虑验证的额外成本和偏倚风险。

此外,大型语言模型本身和围绕它们形成的社区都表现出一些独特而有趣的行为。我们强调这一研究方向的前景,随着人工智能在日常生活中越来越普遍,这一研究方向将变得越来越重要。

这两个方向相辅相成,后者可以指导前者的发展,而前者可以提高后者的研究效率。

总之,我们认为,虽然人工智能不能取代社会学家,但它将深度融入研究过程;社会科学家也将在指导人工智能发展方面发挥重要作用。

引用

[1] Park, Joon Sung, et al. “Generative agents: Interactive simulacra of human behavior.” Proceedings of the 36th Annual ACM Symposium on User Interface Software and Technology. 2023.

[2] Horton, John J. Large language models as simulated economic agents: What can we learn from homo silicus?. No. w31122. National Bureau of Economic Research, 2023.

[3] Bryman, Alan. Social research methods. Oxford university press, 2016.

[4] Bail, Christopher A. “Can generative AI improve social science?.” (2023).

[5] Zimbardo, Philip G., et al. “The Stanford prison experiment.” (1971).

[6] Jiang, Guangyuan, et al. “Evaluating and inducing personality in pre-trained language models.” Advances in Neural Information Processing Systems 36 (2024).

[7] Miotto, Marilù, Nicola Rossberg, and Bennett Kleinberg. “Who is GPT-3? An exploration of personality, values and demographics.” Proceedings of the Fifth Workshop on Natural Language Processing and Computational Social Science (NLP+ CSS). 2022.

[8] Li, Xingxuan, et al. “Does gpt-3 demonstrate psychopathy? evaluating large language models from a psychological perspective.” arXiv preprint arXiv:2212.10529 (2022).

[9] Kovač, Grgur, et al. “Large language models as superpositions of cultural perspectives.” arXiv preprint arXiv:2307.07870 (2023).

[10] Binz, Marcel, and Eric Schulz. “Using cognitive psychology to understand GPT-3.” Proceedings of the National Academy of Sciences 120.6 (2023): e2218523120.